大きなカーネルによる帰納バイアスと直交方向の空間認識を融合した軽量特徴再構築パラダイム

もしあなたがエッジコンピューティングにおける「あれもこれも」で悩んでいるなら、この記事は一見の価値があるかもしれない。

概要

軽量畳み込みニューラルネットワークの設計において、限られたFLOPsの下で「局所受容野」と「グローバルな空間認識」のバランスを取ることは、常に核心的な課題である。

従来の 畳み込みは受容野のサイズに制限され、通常のSE-Block注意機構はグローバルプーリング操作によって空間位置情報の崩壊を引き起こす。そのため、新たな演算子を開発した。

この構造は、$5 \times 5$ 大カーネル深度畳み込みと座標注意機構(Coordinate Attention)を革新的に融合し、強制残差戦略とGroupNorm最適化により、ハードウェアに優しく、ロバストな位置符号化能力を備えた特徴抽出パラダイムを構築した。

1. 設計動機と理論的背景

コードを分析する前に、このモジュールが解決しようとする三つの核心的な痛点を理解する必要がある。

- 有効受容野(ERF)の限界:従来の軽量ネットワークは 畳み込みの積み重ねに過度に依存している。研究によると、深層ネットワークの実際の有効受容野はしばしばガウス分布を示し、深さとともに減衰するため、大規模な意味的対象を捉えることが困難である。

- 空間意味のミスアライメント(Spatial Misalignment):標準のSEモジュールはGlobal Average Poolingにより特徴マップを に圧縮し、チャネル依存性を強化する一方で、物体の空間座標情報を完全に失う。

- マイクロバッチ統計の不安定性(Micro-Batch Instability):エッジデバイスで転移学習やファインチューニングを行う際、メモリの制約によりバッチサイズが非常に小さくなる(例えば2や4)。このとき、BatchNormの統計量推定に大きな偏りが生じ、学習が発散する。

そして、今回構築した注意機構融合畳み込みカーネルは、上記の理論的背景に基づく解決策である。

2. コアアーキテクチャの解析

このモジュールは単純な層の積み重ねではなく、緻密に設計された特徴再構築の閉ループである。以下、コードの論理に沿って段階的に深く分析する。

2.1 大カーネル深度畳み込みによる帰納バイアス

self.dw_conv = nn.Conv2d(c1, c1, kernel_size=5, stride=s, padding=2, groups=c1, bias=False)

設計:畳み込みカーネルを から に拡大した。情報理論の観点から、これは単一ニューロンの「可視領域」を増加させる。

理論的優位性:$5 \times 5$ 畳み込みの受容野面積は の 倍である。軽量ネットワーク(MobileNetV3など)において、このような大カーネル深度畳み込みはTransformerのToken Mixerの動作を効果的に模倣し、テクスチャや形状の捉える能力を強化する。また、NCNNなどの推論フレームワークは DW演算子に対してWinogradアルゴリズムの高度な最適化サポートを既に備えている。

2.2 直交特徴分解と座標注意機構

これは本モジュールの「魂」である。SEのグローバルプーリングとは異なり、このモジュールは二つの直交する1D Global Pooling操作を利用して空間情報を分解する。

步骤 I:正交投影

x_h = self.pool_h(feat) # Output: (N, C, H, 1)

x_w = self.pool_w(feat) # Output: (N, C, 1, W)

- 数学的表現:入力テンソル は水平座標 と垂直座標 に沿ってそれぞれ集約される。この操作により、二つの方向を認識する特徴マップが生成され、ネットワークが一つの空間方向に沿った長距離依存性を捉え、同時に他の方向の正確な位置情報を保持できるようになる。

步骤 II:跨维度交互与降维

y = torch.cat([x_h, x_w], dim=2)

y = self.conv_pool(y)

y = self.gn(y) # GroupNorm for stability

最適化戦略:ここでは

reduction=16のボトルネック層を導入し、モデルの複雑さを低減する。改良点:GroupNormの導入は点睛の筆である。注意機構ブランチの中間層では特徴チャネルが圧縮され、しばしば極めて小さなバッチサイズを伴う。GNはチャネルをグループ化して正規化し、その統計量はバッチサイズに依存しないため、ファインチューニングタスクにおけるBN層の「統計量ドリフト」問題を解決する。

步骤 III:注意力重校准

a_h = self.conv_h(x_h).sigmoid()

a_w = self.conv_w(x_w).sigmoid()

out = identity_feat * a_w * a_h

- 特徴融合:最終的な出力特徴マップは、元の特徴と二つの方向の注意マップとのHadamard積によって得られる。これは、特徴マップ上の各ピクセル に対して、グローバルな文脈に基づいて計算された「重要度重み」を割り当てることに相当する。

2.3 强制残差流

if self.use_res:

return x + out

- 勾配流の保護:注意機構は本質的に「ソフトゲーティング」である。訓練初期において、注意重みはゼロに近い可能性がある。強制残差接続は恒等写像の経路を構築し、最悪の場合(注意層の機能不全)でも、本モジュールが標準的な畳み込み層に退化し、深層ネットワークの勾配の効果的な逆伝播を保証し、勾配消失を回避する。

3. 詳細な実行フローとテンソルの進化

このモジュール内部のデータフローをより明確に示すため、Forward過程を以下の詳細なステップとして形式化する。

空間特徴抽出:

- 入力 。

- DWConv PWConv BN Hardswish を経由。

- 中間特徴 を出力。

座標情報の符号化:

- H-Pooling: を に圧縮。

- W-Pooling: を に圧縮。

変換と活性化:

- と を結合し、$1 \times 1$ 畳み込みで に次元削減。

- GroupNorm(1, mip) で正規化(ここで Group=1 は LayerNorm と同等だが、チャネル次元に対して行う)。

- 非線形活性化関数を適用。

デコードと再重み付け:

- 特徴テンソルを空間認識の重みベクトル と に再分割。

- (ここで はブロードキャスト機構による要素ごとの積を表す)。

特徴再構築(Reconstruction):

- 最終出力 (残差条件を満たす場合)。

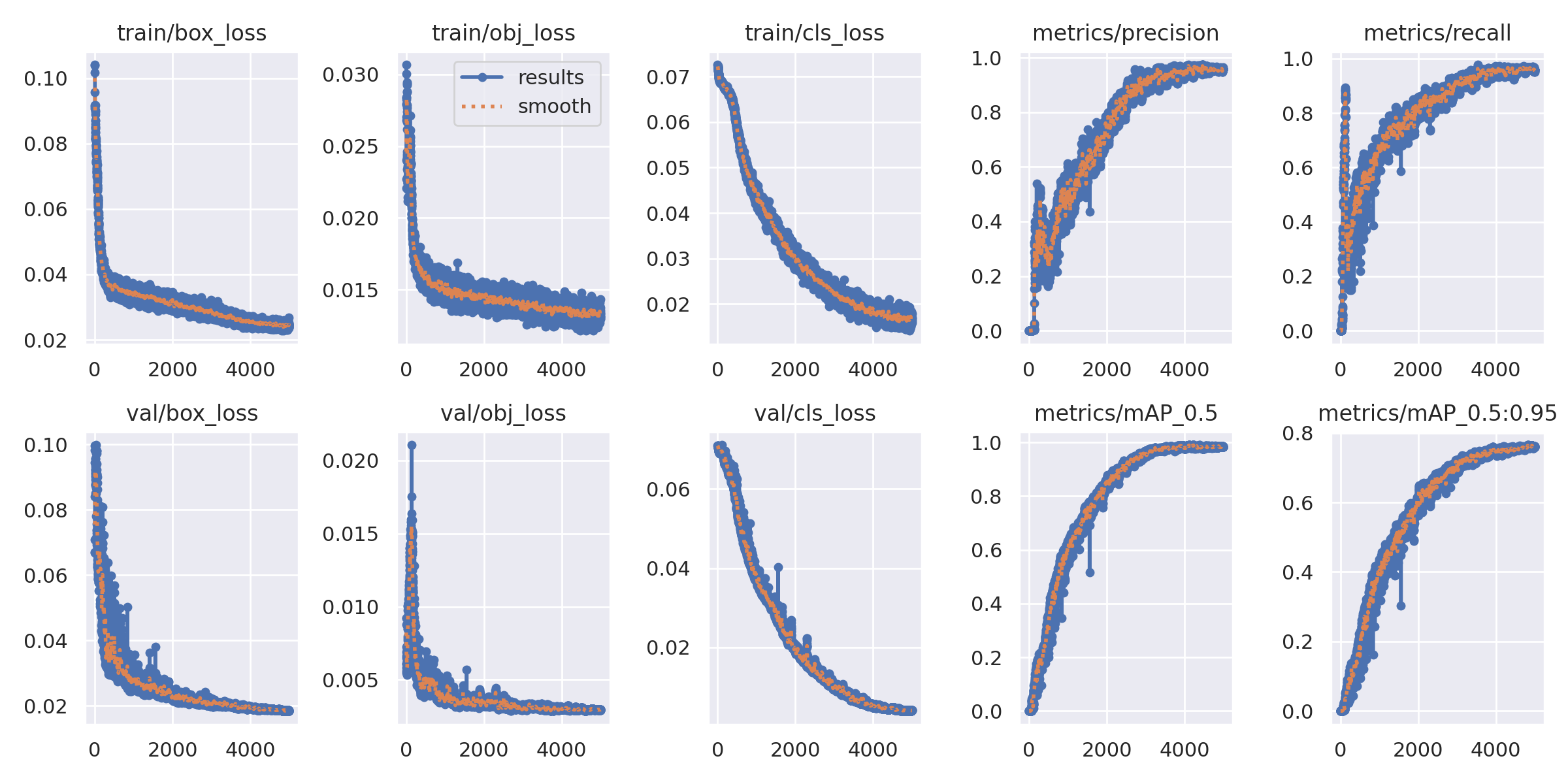

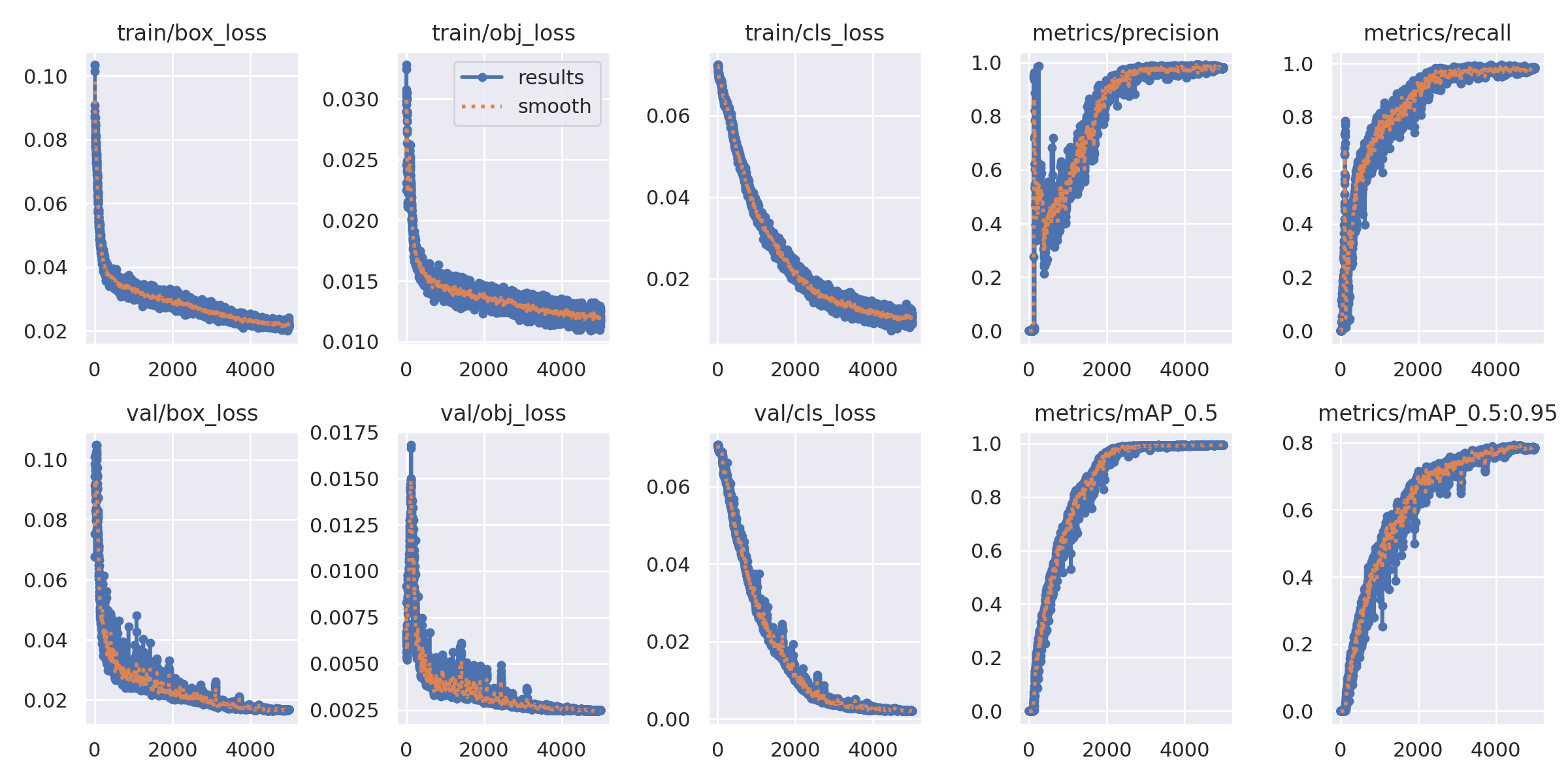

4. 実験検証とデータ可視化

この畳み込みカーネルの実シーンにおける有効性を検証するため、制御された環境で厳密な比較実験を行った。

実験設定:

- データセット:カスタム検出データセット(警棒、懐中電灯、ナイフなどの高類似度カテゴリを含む)。

- 訓練戦略:SGD オプティマイザ、Cosine LR スケジューラ、5000エポックの訓練(モデルが完全に収束することを保証するため)。

ベースライン:本モジュールを標準の3x3 DWConvに置き換えただけであり、その他のネットワークアーキテクチャは完全に同一である。

4.1 全体性能評価:計算量と精度のトレードオフ分析

通常

改善

データ解釈: 上記の表に示すように、この畳み込みカーネルはパラメータ数がほぼ増加せず、FLOPsがわずか0.05G増加(ほぼ無視できる)したにもかかわらず、mAP@50-95で驚異的な10%の絶対的な向上を達成した。これは、本モジュールが単純なパラメータの積み上げによって性能を得ているのではなく、より効率的な空間特徴モデリングによってモデルの表現能力を向上させたことを証明している。

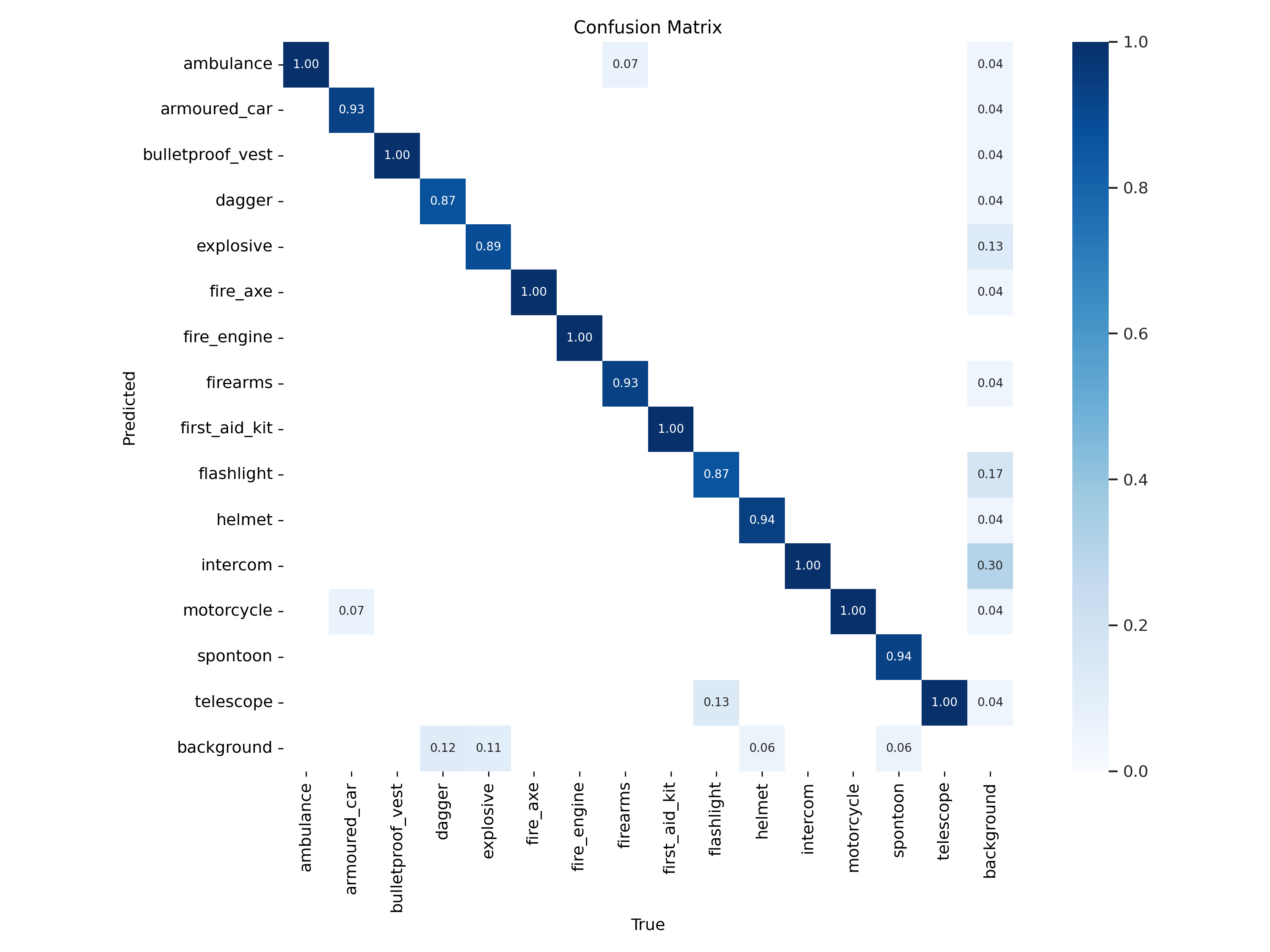

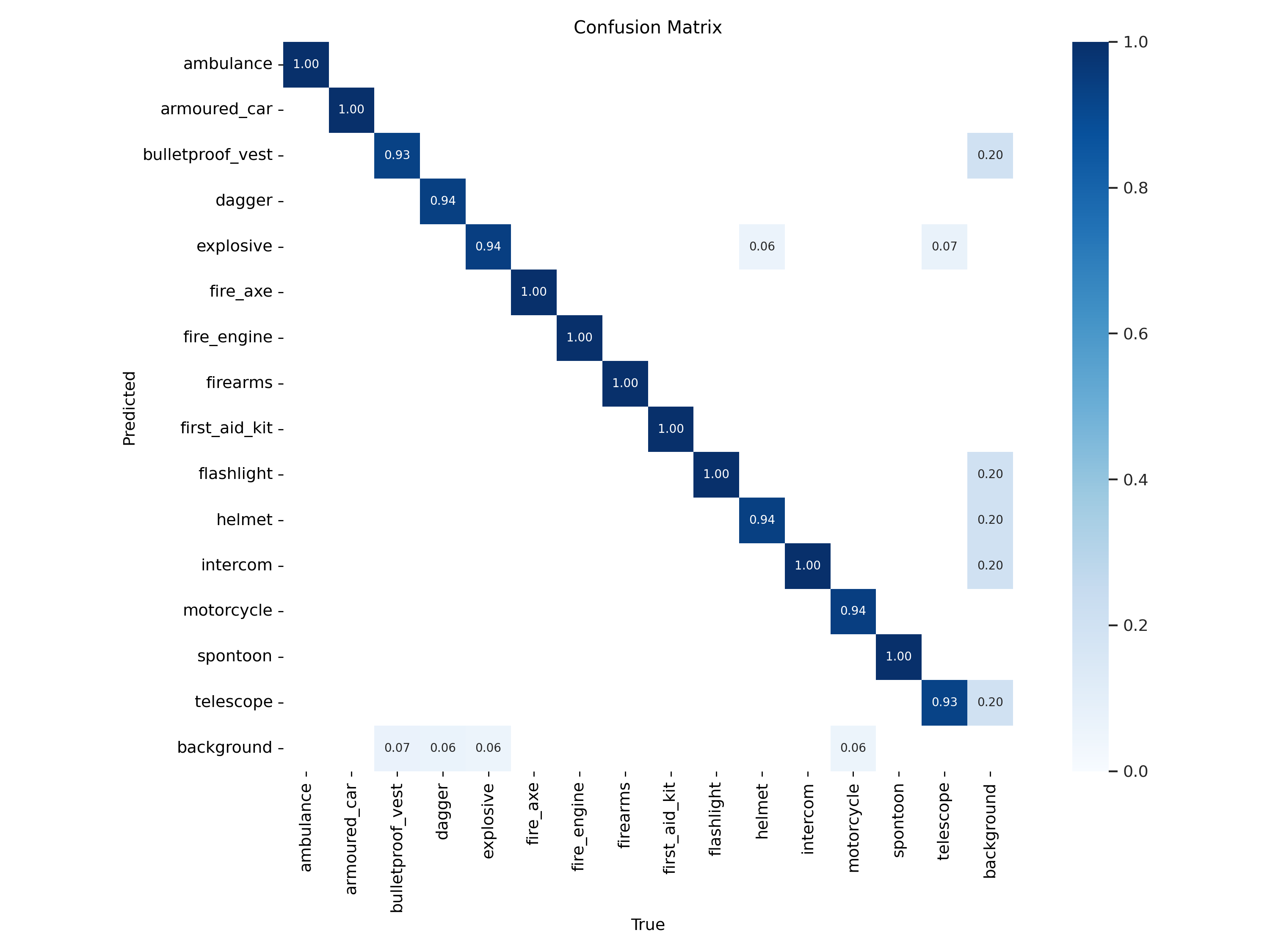

4.2 難例マイニングと細粒度分類

テストにおいて、「クラス間類似性」が最大の課題であった。

例えば、細長い形状の「警棒」と「懐中電灯」は低解像度では極めて区別が難しい。

これらの特定カテゴリにおけるモデルのTop-1 Accuracyを抽出し、比較分析を行った:

通常

改善

5. 結論

この演算子は、非常に先進的な軽量ネットワーク設計のアイデアを示している。

- 畳み込みにより、より強力な空間帰納バイアスを導入した。

- 座標注意機構により、標準CNNが位置認識能力を欠く問題を解決した。

- GroupNormとHardswishにより、優れた工学的実装意識を示し、小サンプルファインチューニングやエッジ推論のシナリオで非常に高い実用価値を持つ。

このモジュールはプラグアンドプレイのコンポーネントであるだけでなく、今後の軽量検出ネットワーク設計のための標準的な空間-チャネル分離パラダイムを提供する。